AI Model Orchestration & LLM Routing Dienste

Hören Sie auf, jede KI-Aufgabe durch ein einziges Modell zu zwingen. Wir bauen die intelligente Routing-Ebene, die für jede Aufgabe das richtige Modell einsetzt - zu den richtigen Kosten.

LLM Routing for Enterprise AI

In 2026 and beyond, enterprise AI strategy is no longer a question of which large language model to choose. It is a question of how to intelligently coordinate multiple models — each with different strengths, cost profiles, and performance characteristics — to deliver consistent, high-quality AI output across your entire organisation.

Unternehmen, die für jede Aufgabe ein einzelnes LLM verwenden, zahlen entweder zu viel für einfache Abfragen oder zu wenig für komplexe Abfragen. Eine gut durchdachte Modell-Orchestrierungsschicht ändert dies: Leichtgewichtige Aufgaben führen zu schnelleren, kosteneffizienten Modellen; komplexe Schlussfolgerungen führen zu Grenzmodellen; domänenspezifische Aufgaben führen zu fein abgestimmten Spezialisten. Das Ergebnis ist eine KI-Infrastruktur, die im großen Maßstab bessere Leistungen erbringt und deutlich weniger kostet.

Carmatec offers AI model orchestration and LLM routing as a standalone service, enabling organisations to route each task to the right model for better output quality, lower operating cost, and stronger business advantage.

Was wir bauen

Dynamische LLM-Routing-Architektur

Wir entwickeln und erstellen intelligente Routing-Ebenen, die eingehende KI-Anfragen nach Komplexität, Domäne, Latenzanforderungen und Kostenschwelle klassifizieren und dann jede Anfrage in Echtzeit an das optimale Modell weiterleiten. Ihre Nutzer erleben eine nahtlose KI-Leistung. Ihr Finanzteam sieht drastisch niedrigere Token-Kosten. Ihr Betriebsteam erhält vollen Einblick in die Modellnutzung im gesamten Unternehmen.

Multi-Modell Strategieberatung

Bevor wir bauen, helfen wir Ihnen zu entscheiden, was Sie bauen wollen. Unsere Multi-Modell-Strategieberatung definiert Ihr Modellportfolio - welche Frontier-Modelle, welche Open-Source-Modelle, welche fein abgestimmten Spezialisten - und die Geschäftslogik, die den Routing-Entscheidungen zugrunde liegen sollte. Wir führen Benchmark-Tests anhand Ihrer tatsächlichen Anwendungsfälle durch, nicht anhand von Anbieter-Benchmarks, um eine Strategie zu entwickeln, die auf Fakten beruht.

AI Gateway Entwicklung

Wir bauen zentralisierte KI-Gateways, die als sicherer, kontrollierter Eingangspunkt für den gesamten LLM-Datenverkehr in Ihrem Unternehmen fungieren. Das Gateway kümmert sich um Authentifizierung, Ratenbegrenzung, Nutzungsprotokollierung, Kostenzuweisung und Richtliniendurchsetzung. So erhält Ihr Team eine einzige Kontrollebene für Ihren gesamten KI-Modellbestand, unabhängig davon, wie viele Anbieter oder Modelle Sie betreiben.

Modell der Ausfallsicherung und des Lastausgleichs

KI-Systeme in der Produktion können sich keine einzelnen Fehlerpunkte leisten. Wir integrieren Failover und Lastausgleich in jede Modell-Orchestrierungsschicht: Wenn die Leistung eines Anbieters nachlässt oder ein Ausfall auftritt, wird der Datenverkehr automatisch zu einem Ausweichmodell geleitet, ohne dass die Benutzer davon betroffen sind. Außerdem verteilen wir die Last auf die einzelnen Modellinstanzen, um eine konsistente Latenz bei der Skalierung zu gewährleisten.

AI-Kostenoptimierung durch intelligentes Routing

Die Token-Kosten steigen im Unternehmensmaßstab. Bei der Entwicklung unserer Routing-Architekturen steht die Kostenoptimierung im Vordergrund: Durch die Weiterleitung kurzer, einfacher Abfragen an kleinere Modelle können die KI-Infrastrukturkosten um 40-60% gesenkt werden, verglichen mit der Ausführung aller Aufgaben durch Frontier-Modelle, ohne dass sich die Qualität der Ausgabe für diese Aufgaben messbar verschlechtert.

Souveränes AI-Modell-Management

Für Kunden der Regierung der Vereinigten Arabischen Emirate und Organisationen mit strengen Anforderungen an die Datenresidenz entwickeln wir Modell-Orchestrierungsarchitekturen, die sensible Arbeitslasten ausschließlich an lokale oder regionale Modellbereitstellungen weiterleiten, während nicht sensible Arbeitslasten die leistungsfähigsten Cloud-basierten Modelle nutzen können. Datenhoheit und KI-Leistung sind kein Widerspruch - mit der richtigen Architektur können Sie beides erreichen.

Warum dies jetzt wichtig ist

Die KI-Landschaft für Unternehmen fragmentiert sich schnell. OpenAI, Anthropic, Google, Meta, Mistral und Dutzende von Open-Source-Modellanbietern bieten jeweils unterschiedliche Funktionen und Preismodelle an. Unternehmen, die sich heute an einen einzigen Anbieter binden, werden morgen mit Wechselkosten, Fähigkeitslücken und Kostendruck konfrontiert sein. Eine gut durchdachte Orchestrierungsschicht gibt Ihnen die Flexibilität, für jede Aufgabe das beste Modell zu wählen - heute und in der Zukunft, wenn sich der Markt weiterentwickelt.

Prozess

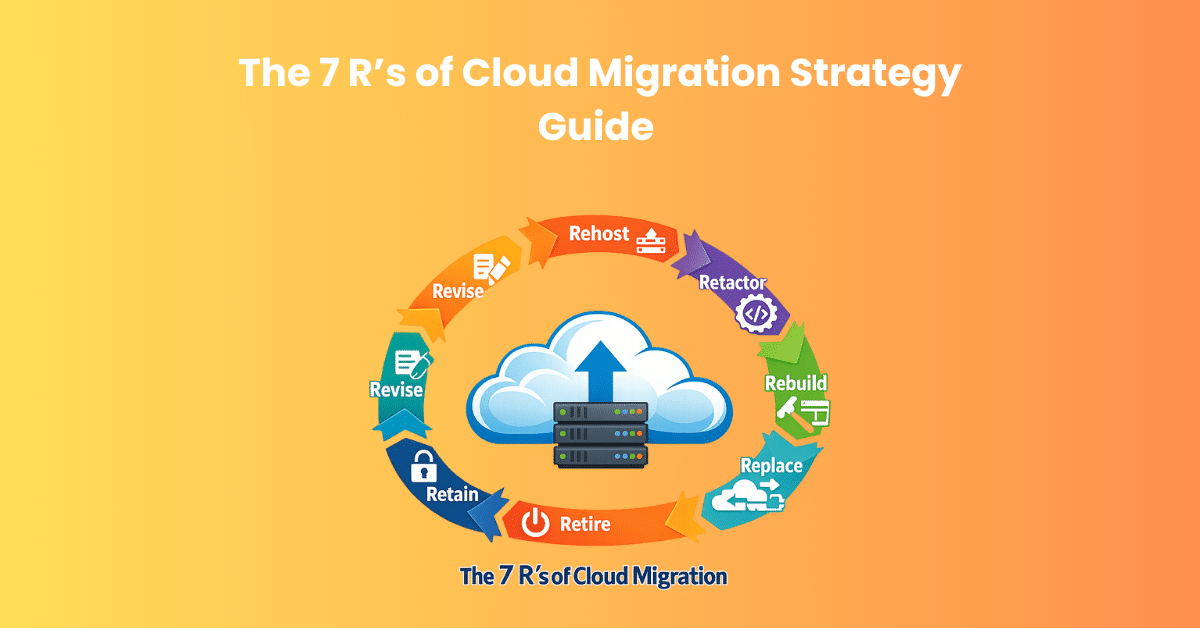

Identifizieren Sie Anwendungsfälle

Definieren Sie, wo Multi-Model-Routing einen Mehrwert bietet

LLMs auswählen

Auswahl der Modelle nach Kosten, Geschwindigkeit und Genauigkeit

Definieren Sie Routing-Regeln

Logik für aufgabenbasiertes und Fallback-Routing festlegen

Orchestrierungsschicht aufbauen

Schaffung eines Systems zur Verwaltung mehrerer Modelle

Integrieren und einsetzen

Verbindung mit bestehenden Anwendungen und Infrastrukturen

Überwachen und optimieren

Leistung verfolgen und kontinuierlich verbessern

Vorteile

Niedrigere Kosten

Verwenden Sie kosteneffiziente Modelle für einfachere Aufgaben

Höhere Genauigkeit

Zuweisung von Aufgaben an die am besten geeigneten Modelle

Schnellere Antworten

Verringerung der Latenzzeit durch optimiertes Routing

Skalierbarkeit

Steigende Arbeitsbelastungen leicht unterstützen

Flexibilität des Anbieters

Vermeidung der Abhängigkeit von einem einzigen Anbieter

Zuverlässigkeit

Sicherstellung der Betriebszeit mit Failover-Mechanismen

Warum uns wählen

Multi-LLM-Fachwissen

Erfahrung mit führenden KI-Modellen

Kundenspezifische Lösungen

Maßgeschneidertes Routing für Ihre Geschäftsanforderungen

Unternehmensarchitektur

Entwickelt für Skalierbarkeit, Sicherheit und Leistung

Schwerpunkt Kostenoptimierung

Maximierung des ROI durch effiziente Nutzung

End-to-End-Unterstützung

Von der Strategie zur laufenden Optimierung

Nahtlose Integration

Funktioniert reibungslos mit Ihren bestehenden Systemen

Sind Sie an einer Investition in AI Model Orchestration & LLM Routing Services interessiert?

Wenden Sie sich bitte an unseren Spezialisten für generative KI-Entwicklung. Wir freuen uns sowohl über bestehende spezifische Anwendungsfälle als auch über übergeordnete Ideen für zukünftige Anwendungen.