AI Model Orchestration & LLM Routing Services

Sluta tvinga varje AI-uppgift genom en enda modell. Vi bygger det intelligenta routinglagret som sätter rätt modell i arbete för varje jobb - till rätt kostnad.

LLM Routing for Enterprise AI

In 2026 and beyond, enterprise AI strategy is no longer a question of which large language model to choose. It is a question of how to intelligently coordinate multiple models — each with different strengths, cost profiles, and performance characteristics — to deliver consistent, high-quality AI output across your entire organisation.

Organisationer som kör en enda LLM för varje uppgift betalar antingen för mycket för enkla frågor eller för lite för komplexa frågor. Ett välarkitekterat lager för modellorkestrering ändrar detta: lätta uppgifter leder till snabbare, kostnadseffektiva modeller; komplexa resonemang leder till gränsmodeller; domänspecifika uppgifter leder till finjusterade specialister. Resultatet är en AI-infrastruktur som presterar bättre och kostar betydligt mindre i stor skala.

Carmatec offers AI model orchestration and LLM routing as a standalone service, enabling organisations to route each task to the right model for better output quality, lower operating cost, and stronger business advantage.

Vad vi bygger

Arkitektur för dynamisk LLM-routning

Vi designar och bygger intelligenta routningslager som klassificerar inkommande AI-förfrågningar efter komplexitet, domän, latensbehov och kostnadströskel - och sedan routar varje förfrågan till den optimala modellen i realtid. Dina användare upplever sömlös AI-prestanda. Ditt ekonomiteam ser dramatiskt lägre kostnader för token. Ditt operativa team får full insyn i modellanvändningen i hela organisationen.

Strategikonsultation med flera modeller

Innan vi bygger hjälper vi dig att bestämma vad du ska bygga. Vår strategikonsultation för flera modeller definierar din modellportfölj - vilka gränsmodeller, vilka modeller med öppen källkod, vilka finjusterade specialister - och den affärslogik som ska styra routingbeslut. Vi genomför benchmarktester mot era faktiska användningsfall, inte mot leverantörers benchmarks, för att ta fram en strategi som är grundad på bevis.

Utveckling av AI-gateway

Vi bygger centraliserade AI-gateways som fungerar som en säker, reglerad ingångspunkt för all LLM-trafik i din organisation. Gatewayen hanterar autentisering, hastighetsbegränsning, användningsloggning, kostnadsattribution och policygenomdrivning - vilket ger ditt team ett enda kontrollplan för hela din AI-modell, oavsett hur många leverantörer eller modeller du kör.

Modell Failover och lastbalansering

AI-system i produktion har inte råd med enstaka felkällor. Vi bygger in failover och belastningsutjämning i varje modellorkestreringslager: om en leverantör upplever försämrad prestanda eller ett avbrott dirigeras trafiken automatiskt till en reservmodell utan att användaren påverkas. Vi fördelar också belastningen över modellinstanser för att säkerställa konsekvent latens i stor skala.

AI-kostnadsoptimering genom intelligent routning

Tokenkostnaderna ökar i stor skala. Våra routningsarkitekturer är utformade med kostnadsoptimering som ett primärt mål: routing av korta, enkla frågor till mindre modeller kan minska AI-infrastrukturkostnaderna med 40-60% jämfört med att köra allt genom frontier-modeller, utan mätbar försämring av utskriftskvaliteten för dessa uppgifter.

Suverän AI-modellhantering

För statliga kunder i Förenade Arabemiraten och organisationer med strikta krav på dataresidens utformar vi arkitekturer för modellorkestrering som dirigerar känsliga arbetsbelastningar uteslutande till lokala eller regionala modelldistributioner, samtidigt som icke-känsliga arbetsbelastningar kan utnyttja de mest kapabla molnbaserade modellerna. Datasuveränitet och AI-prestanda är inte en avvägning - med rätt arkitektur uppnår du båda.

Varför detta är viktigt nu

AI-landskapet för företag fragmenteras snabbt. OpenAI, Anthropic, Google, Meta, Mistral och dussintals leverantörer av öppen källkodsmodeller erbjuder alla olika funktioner och prismodeller. Organisationer som låser sig vid en enda leverantör i dag kommer att möta kostnader för att byta leverantör, kapacitetsgap och kostnadstryck i morgon. Ett väl utformat orkestreringslager ger dig flexibiliteten att anta den bästa modellen för varje uppgift - idag och när marknaden utvecklas.

Process

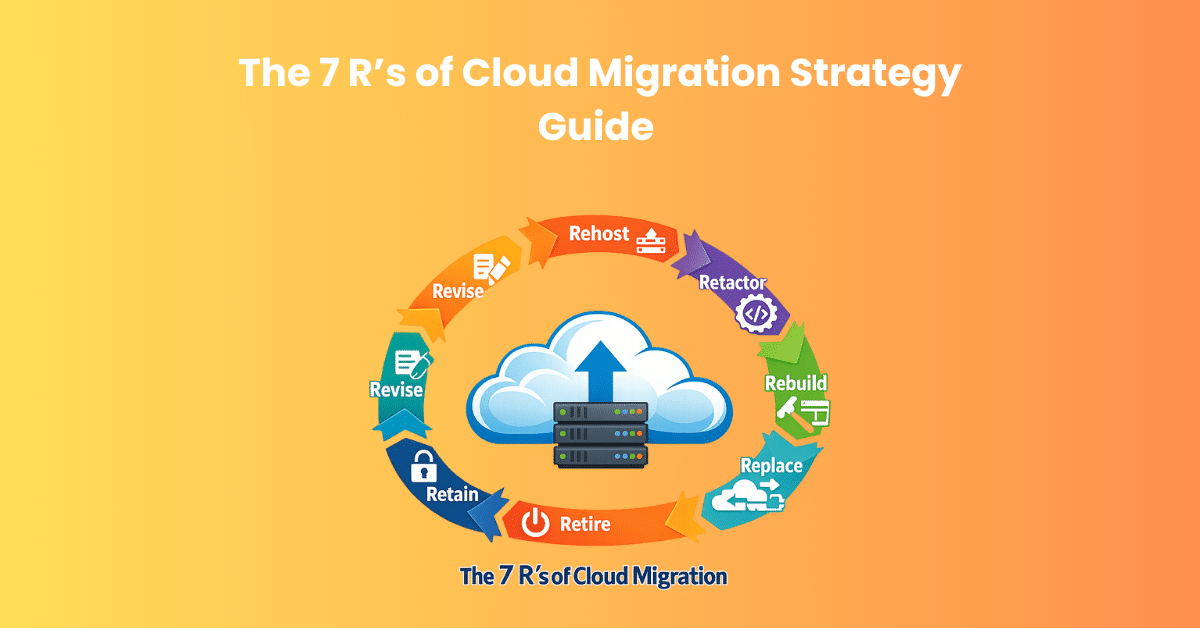

Identifiera användningsfall

Definiera var routing med flera modeller ger mervärde

Välj LLM

Välj modeller baserat på kostnad, hastighet och noggrannhet

Definiera routningsregler

Ställ in logik för uppgiftsbaserad och reservrutin

Bygg ett orkestreringslager

Skapa ett system för att hantera flera modeller

Integrera och driftsätta

Anslut till befintliga appar och infrastruktur

Övervaka och optimera

Följ upp resultat och förbättra kontinuerligt

Fördelar

Lägre kostnader

Använd kostnadseffektiva modeller för enklare uppgifter

Högre noggrannhet

Tilldela uppgifter till de mest lämpliga modellerna

Snabbare svar

Minska latenstiden med optimerad routing

Skalbarhet

Enkelt att hantera ökande arbetsbelastningar

Flexibilitet för leverantörer

Undvik beroende av en enda leverantör

Pålitlighet

Säkerställ drifttid med failover-mekanismer

Varför välja oss

Multi-LLM-expertis

Erfarenhet av ledande AI-modeller

Anpassade lösningar

Routning skräddarsydd efter dina affärsbehov

Företagsarkitektur

Byggd för skala, säkerhet och prestanda

Fokus på kostnadsoptimering

Maximera ROI med effektiv användning

Stöd från början till slut

Från strategi till löpande optimering

Sömlös integration

Fungerar smidigt med dina befintliga system

Är du intresserad av att investera i AI Model Orchestration & LLM Routing Services?

Kontakta gärna vår specialist på utveckling av generativ AI. Vi välkomnar både befintliga specifika användningsfall och idéer på hög nivå för framtida appar.